深度学习——YOLOv4损失函数全面解析

深度学习——YOLOv4损失函数全面解析

1.前言

正文开始之前,非常感谢各位能够赏脸,上一篇《YOLO V4 — 网络结构解析(特详细!)》已经获得了我个人总结性文章历史最高赞了,感谢大家一直以来的支持,后面我也会尽量挤出时间对一些文章和代码进行解析,和大家一同进步。

如果您对YOLO V4的结构比较感兴趣,建议您可以结合代码以及我的这篇文章进行消化。代码是基于Keras版本的,结构很清晰,链接如下:

YOLO V4 Keras:https:github.com/Ma-Dan/keras-yolo4

YOLO V4相较于YOLO V3做了很多小创新,堪称目标检测tricks万花筒。既然YOLO V4结构大家都懂了,根据网络的输出和标签信息进行损失函数的设定,实现网络参数的更新,一个完整的YOLO V4模型训练过程就可以被复现了。

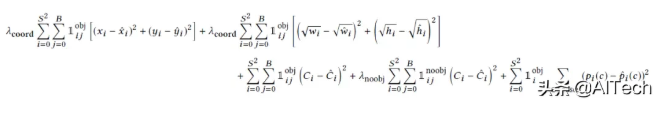

YOLO V4原文中提到,在进行bounding box regression的时候,传统的目标检测模型(比如YOLO V3)等,都是直接根据预测框和真实框的中心点坐标以及宽高信息设定MSE(均方误差)损失函数的。为了方便大家理解,下面给出了YOLO V3的总损失函数。

YOLO V3的损失函数

可以看出,第一行的两个,就是用在bounding box regression的损失函数MSE。有关该损失函数的具体解析可以见我文章《YOLO V3 深度解析 (下)》(https://zhuanlan.zhihu.com/p/138857662),这里就不进行赘述。

2. IOU损失函数理论部分

鉴于MSE存在的一些问题,比如原文中提到

However, to directly estimate the coordinate values of each point of the BBox is to treat these points as independent variables, but in fact does not consider the integrity of the object itself.

意思就是MSE损失函数将检测框中心点坐标和宽高等信息作为独立的变量对待的,但是实际上他们之间是有关系的。从直观上来说,框的中心点和宽高的确存在着一定的关系。所以解决方法是使用IOU损失代替MSE损失。

接着作者就IOU损失依次提到了以下的一些的损失函数。

- (1)IOU损失

- (2)GIOU损失

- (3)DIOU损失

- (4)CIOU损失

(1)IOU损失

其中IOU损失定义非常简单,即1与预测框A和真实框B之间交并比的差值

但是这样该损失函数会有一些问题,该损失函数只在bounding box重叠的时候才管用,在他们没有重叠情况下,将不会提供滑动梯度。(这句话摘自论文《Distance-IoU Loss: Faster and Better Learning for Bounding Box Regression》)

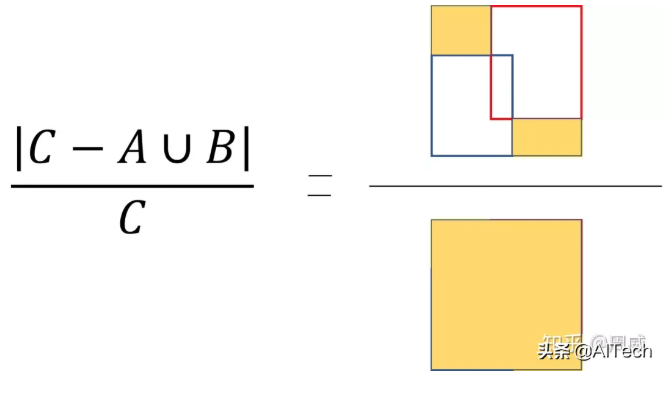

(2)GIOU损失

其实GIOU的全称叫做 :generalized IoU loss。提出来是为了缓解上述IOU损失在检测框不重叠时出现的梯度问题。定义也是比较简单的,就在在原来的IOU损失的基础上加上一个惩罚项,公式如下:

上式中A是预测框,B是真实框,C是A和B的最小包围框,A,B,C的关系具体如下图所示。

A,B,C含义

那么该惩罚项的意思就是下图右边黄色区域的比值。

惩罚项含义

惩罚项含义

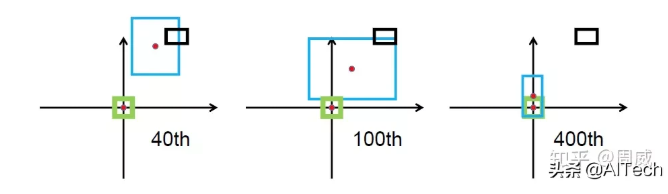

虽然GIOU可以解决检测框非重叠造成的梯度消失问题,但是他还存在以下的限制,这里我们依旧是参考CIOU论文中的内容。

GIOU回归过程

GIOU回归过程

上图中绿色为真实框,黑色为先验框Anchor,蓝色为预测框。预测框是以先验框为基础进行位置移动和大小缩放的。可以看出来,GIOU首先尝试增大预测框的大小,使得它能够与真实框有所重叠(如上图中间所示),然后才能进行上述公式中 的计算。那么这样做的话,会消耗大量的时间在预测框尝试与真实框接触上,这会影响损失的收敛速度。所以DIOU和GIOU的提出解决了上述GIOU的问题。

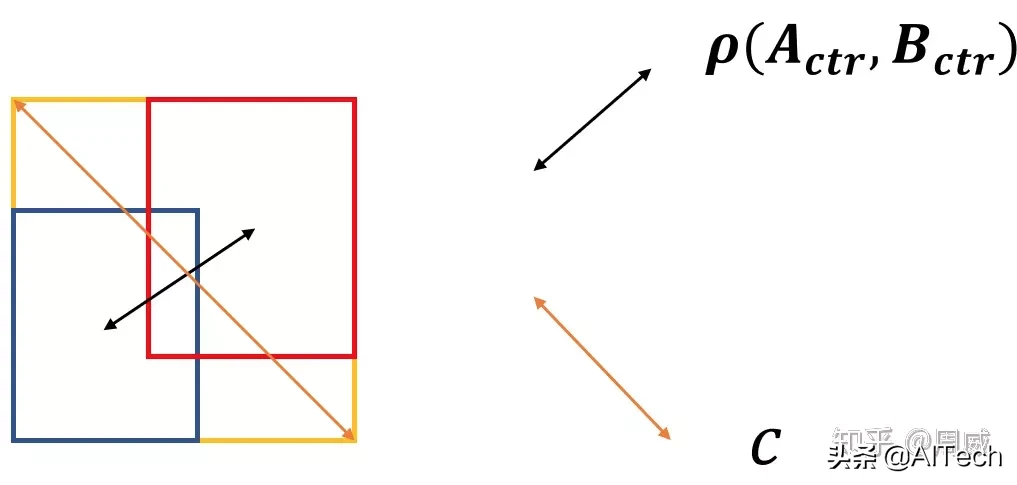

(3)DIOU

DIOU和CIOU都出自论文《Distance-IoU Loss: Faster and Better Learning for Bounding Box Regression》(https://link.zhihu.com/?target=https%3A//arxiv.org/abs/1911.08287)。作者说他直接在IOU损失的基础上加了一个简单的惩罚项,用来最小化两个检测框中心点的标准化距离, 这样可以加速损失的收敛过程。如下图所示为GIOU和DIOU的对比。

红色框是DIOU损失中的预测框。可以很明显的看出,DIOU的收敛速度较GIOU更快。

那么有关DIOU的定义是怎么样的呢?下面给出公式定义:

相比于IOU损失,DIOU损失也多出了一个惩罚项 。该惩罚项具体的参数含义为

- A : 预测框 B:真实框

- : 预测框中心点坐标 :真实框中心点坐标

- 是欧式距离的计算

- c 为 A , B 最小包围框的对角线长度

我给出了下图,便于大家理解。

所以两个框距离越远,DIOU越接近2,距离越近,DIOU越接近0。

提出DIOU还不够,作者进一步地提出了CIOU(Complete IoU Loss)。

(4)CIOU

CIOU作者考虑的更加全面一些,DIOU考虑到了两个检测框的中心距离。而CIOU考虑到了三个几何因素,分别为

- (1)重叠面积

- (2)中心点距离

- (3)长宽比

这里仔细观察,会发现,CIOU比DIOU多了一个长宽比的信息,那么CIOU的公式定义如下:

那么这个 对长宽比的惩罚项了。论文中提到, 是一个正数, 用来测量长宽比的一致性(v measures the consistency of aspect ratio)。具体定义如下:

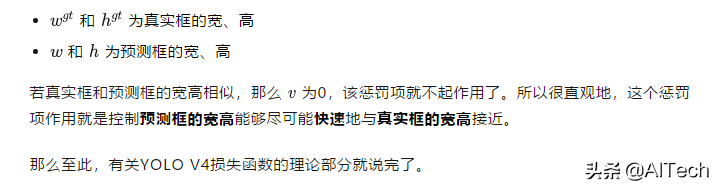

上述公式中,参数说明如下:

3.IOU损失函数的实战部分

说完了上述四个IOU理论部分,我们回归其在YOLO V4框架中的位置并进行解析。结合keras的代码,如下为CIOU损失函数的定义。

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 |

def bbox_ciou(boxes1, boxes2): <span class="hljs-string">''</span><span class="hljs-string">'</span> <span class="hljs-string"> 计算ciou = iou - p2/c2 - av</span> <span class="hljs-string"> :param boxes1: (8, 13, 13, 3, 4) pred_xywh</span> <span class="hljs-string"> :param boxes2: (8, 13, 13, 3, 4) label_xywh</span> <span class="hljs-string"> :return:</span> <span class="hljs-string"> 举例时假设pred_xywh和label_xywh的shape都是(1, 4)</span> <span class="hljs-string"> '</span><span class="hljs-string">''</span> # 变成左上角坐标、右下角坐标 boxes1_x0y0x1y1 = tf.<span class="hljs-built_in">concat</span>([boxes1[..., :<span class="hljs-number">2</span>] - boxes1[..., <span class="hljs-number">2</span>:] * <span class="hljs-number">0.5</span>, boxes1[..., :<span class="hljs-number">2</span>] + boxes1[..., <span class="hljs-number">2</span>:] * <span class="hljs-number">0.5</span>], axis=<span class="hljs-number">-1</span>) boxes2_x0y0x1y1 = tf.<span class="hljs-built_in">concat</span>([boxes2[..., :<span class="hljs-number">2</span>] - boxes2[..., <span class="hljs-number">2</span>:] * <span class="hljs-number">0.5</span>, boxes2[..., :<span class="hljs-number">2</span>] + boxes2[..., <span class="hljs-number">2</span>:] * <span class="hljs-number">0.5</span>], axis=<span class="hljs-number">-1</span>) <span class="hljs-string">''</span><span class="hljs-string">'</span> <span class="hljs-string"> 逐个位置比较boxes1_x0y0x1y1[..., :2]和boxes1_x0y0x1y1[..., 2:],即逐个位置比较[x0, y0]和[x1, y1],小的留下。</span> <span class="hljs-string"> 比如留下了[x0, y0]</span> <span class="hljs-string"> 这一步是为了避免一开始w h 是负数,导致x0y0成了右下角坐标,x1y1成了左上角坐标。</span> <span class="hljs-string"> '</span><span class="hljs-string">''</span> boxes1_x0y0x1y1 = tf.<span class="hljs-built_in">concat</span>([tf.minimum(boxes1_x0y0x1y1[..., :<span class="hljs-number">2</span>], boxes1_x0y0x1y1[..., <span class="hljs-number">2</span>:]), tf.maximum(boxes1_x0y0x1y1[..., :<span class="hljs-number">2</span>], boxes1_x0y0x1y1[..., <span class="hljs-number">2</span>:])], axis=<span class="hljs-number">-1</span>) boxes2_x0y0x1y1 = tf.<span class="hljs-built_in">concat</span>([tf.minimum(boxes2_x0y0x1y1[..., :<span class="hljs-number">2</span>], boxes2_x0y0x1y1[..., <span class="hljs-number">2</span>:]), tf.maximum(boxes2_x0y0x1y1[..., :<span class="hljs-number">2</span>], boxes2_x0y0x1y1[..., <span class="hljs-number">2</span>:])], axis=<span class="hljs-number">-1</span>) # 两个矩形的面积 boxes1_area = (boxes1_x0y0x1y1[..., <span class="hljs-number">2</span>] - boxes1_x0y0x1y1[..., <span class="hljs-number">0</span>]) * ( boxes1_x0y0x1y1[..., <span class="hljs-number">3</span>] - boxes1_x0y0x1y1[..., <span class="hljs-number">1</span>]) boxes2_area = (boxes2_x0y0x1y1[..., <span class="hljs-number">2</span>] - boxes2_x0y0x1y1[..., <span class="hljs-number">0</span>]) * ( boxes2_x0y0x1y1[..., <span class="hljs-number">3</span>] - boxes2_x0y0x1y1[..., <span class="hljs-number">1</span>]) # 相交矩形的左上角坐标、右下角坐标,shape 都是 (<span class="hljs-number">8</span>, <span class="hljs-number">13</span>, <span class="hljs-number">13</span>, <span class="hljs-number">3</span>, <span class="hljs-number">2</span>) left_up = tf.maximum(boxes1_x0y0x1y1[..., :<span class="hljs-number">2</span>], boxes2_x0y0x1y1[..., :<span class="hljs-number">2</span>]) right_down = tf.minimum(boxes1_x0y0x1y1[..., <span class="hljs-number">2</span>:], boxes2_x0y0x1y1[..., <span class="hljs-number">2</span>:]) # 相交矩形的面积inter_area。iou inter_section = tf.maximum(right_down - left_up, <span class="hljs-number">0.0</span>) inter_area = inter_section[..., <span class="hljs-number">0</span>] * inter_section[..., <span class="hljs-number">1</span>] union_area = boxes1_area + boxes2_area - inter_area iou = inter_area / (union_area + K.epsilon()) # 包围矩形的左上角坐标、右下角坐标,shape 都是 (<span class="hljs-number">8</span>, <span class="hljs-number">13</span>, <span class="hljs-number">13</span>, <span class="hljs-number">3</span>, <span class="hljs-number">2</span>) enclose_left_up = tf.minimum(boxes1_x0y0x1y1[..., :<span class="hljs-number">2</span>], boxes2_x0y0x1y1[..., :<span class="hljs-number">2</span>]) enclose_right_down = tf.maximum(boxes1_x0y0x1y1[..., <span class="hljs-number">2</span>:], boxes2_x0y0x1y1[..., <span class="hljs-number">2</span>:]) # 包围矩形的对角线的平方 enclose_wh = enclose_right_down - enclose_left_up enclose_c2 = K.<span class="hljs-built_in">pow</span>(enclose_wh[..., <span class="hljs-number">0</span>], <span class="hljs-number">2</span>) + K.<span class="hljs-built_in">pow</span>(enclose_wh[..., <span class="hljs-number">1</span>], <span class="hljs-number">2</span>) # 两矩形中心点距离的平方 p2 = K.<span class="hljs-built_in">pow</span>(boxes1[..., <span class="hljs-number">0</span>] - boxes2[..., <span class="hljs-number">0</span>], <span class="hljs-number">2</span>) + K.<span class="hljs-built_in">pow</span>(boxes1[..., <span class="hljs-number">1</span>] - boxes2[..., <span class="hljs-number">1</span>], <span class="hljs-number">2</span>) # 增加av。加上除<span class="hljs-number">0</span>保护防止nan。 atan1 = tf.<span class="hljs-built_in">atan</span>(boxes1[..., <span class="hljs-number">2</span>] / (boxes1[..., <span class="hljs-number">3</span>] + K.epsilon())) <span class="hljs-built_in">atan2</span> = tf.<span class="hljs-built_in">atan</span>(boxes2[..., <span class="hljs-number">2</span>] / (boxes2[..., <span class="hljs-number">3</span>] + K.epsilon())) v = <span class="hljs-number">4.0</span> * K.<span class="hljs-built_in">pow</span>(atan1 - <span class="hljs-built_in">atan2</span>, <span class="hljs-number">2</span>) / (<span class="hljs-built_in">math</span>.<span class="hljs-built_in">pi</span> ** <span class="hljs-number">2</span>) a = v / (<span class="hljs-number">1</span> - iou + v) ciou = iou - <span class="hljs-number">1.0</span> * p2 / enclose_c2 - <span class="hljs-number">1.0</span> * a * v <span class="hljs-keyword">return</span> ciou |

以上,代码原作者也是做了一个非常详细的代码注释呀。可以看出,该函数定义和理论部分一致,特别是最后一行代码,和我们理论部分说的一模一样哈。

|

1 |

<span class="hljs-attr">ciou</span> = iou - <span class="hljs-number">1.0</span> * p2 / enclose_c2 - <span class="hljs-number">1.0</span> * a * v |

该CIOU函数定义被用在求解总损失函数上了,我们知道YOLO V3的损失函数主要分为三部分,分别为:

- (1)bounding box regression损失

- (2)置信度损失

- (3)分类损失

YOLO V4相较于YOLO V3,只在bounding box regression做了创新,用CIOU代替了MSE,其他两个部分没有做实质改变。其代码分别定义如下:

(1)bounding box regression损失

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 |

<span class="hljs-string">def</span> <span class="hljs-string">loss_layer(conv,</span> <span class="hljs-string">pred,</span> <span class="hljs-string">label,</span> <span class="hljs-string">bboxes,</span> <span class="hljs-string">stride,</span> <span class="hljs-string">num_class,</span> <span class="hljs-string">iou_loss_thresh):</span> <span class="hljs-string">conv_shape</span> <span class="hljs-string">=</span> <span class="hljs-string">tf.shape(conv)</span> <span class="hljs-string">batch_size</span> <span class="hljs-string">=</span> <span class="hljs-string">conv_shape[0]</span> <span class="hljs-string">output_size</span> <span class="hljs-string">=</span> <span class="hljs-string">conv_shape[1]</span> <span class="hljs-string">input_size</span> <span class="hljs-string">=</span> <span class="hljs-string">stride</span> <span class="hljs-string">*</span> <span class="hljs-string">output_size</span> <span class="hljs-string">conv</span> <span class="hljs-string">=</span> <span class="hljs-string">tf.reshape(conv,</span> <span class="hljs-string">(batch_size,</span> <span class="hljs-string">output_size,</span> <span class="hljs-string">output_size,</span> <span class="hljs-number">3</span><span class="hljs-string">,</span> <span class="hljs-number">5</span> <span class="hljs-string">+</span> <span class="hljs-string">num_class))</span> <span class="hljs-string">conv_raw_prob</span> <span class="hljs-string">=</span> <span class="hljs-string">conv[:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-number">5</span><span class="hljs-string">:]</span> <span class="hljs-string">pred_xywh</span> <span class="hljs-string">=</span> <span class="hljs-string">pred[:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-number">0</span><span class="hljs-string">:4]</span> <span class="hljs-string">pred_conf</span> <span class="hljs-string">=</span> <span class="hljs-string">pred[:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-number">4</span><span class="hljs-string">:5]</span> <span class="hljs-string">label_xywh</span> <span class="hljs-string">=</span> <span class="hljs-string">label[:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-number">0</span><span class="hljs-string">:4]</span> <span class="hljs-string">respond_bbox</span> <span class="hljs-string">=</span> <span class="hljs-string">label[:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-number">4</span><span class="hljs-string">:5]</span> <span class="hljs-string">label_prob</span> <span class="hljs-string">=</span> <span class="hljs-string">label[:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-string">:,</span> <span class="hljs-number">5</span><span class="hljs-string">:]</span> <span class="hljs-string">ciou</span> <span class="hljs-string">=</span> <span class="hljs-string">tf.expand_dims(bbox_ciou(pred_xywh,</span> <span class="hljs-string">label_xywh),</span> <span class="hljs-string">axis=-1)</span> <span class="hljs-comment"># (8, 13, 13, 3, 1)</span> <span class="hljs-comment"> input_size = tf.cast(input_size, tf.float32)</span> <span class="hljs-comment"> # 每个预测框xxxiou_loss的权重 = 2 - (ground truth的面积/图片面积)</span> <span class="hljs-comment"> bbox_loss_scale = 2.0 - 1.0 * label_xywh[:, :, :, :, 2:3] * label_xywh[:, :, :, :, 3:4] / (input_size ** 2)</span> <span class="hljs-comment"> ciou_loss = respond_bbox * bbox_loss_scale * (1 - ciou) # 1. respond_bbox作为mask,有物体才计算xxxiou_loss</span> |

(2)置信度损失

|

1 |

最后对上述的三个损失取个平均即可,如下

|

1 2 3 |

<span class="hljs-string">ciou_loss</span> <span class="hljs-string">=</span> <span class="hljs-string">tf.reduce_mean(tf.reduce_sum(ciou_loss,</span> <span class="hljs-string">axis=[1,</span> <span class="hljs-number">2</span><span class="hljs-string">,</span> <span class="hljs-number">3</span><span class="hljs-string">,</span> <span class="hljs-number">4</span><span class="hljs-string">]))</span> <span class="hljs-comment"># 每个样本单独计算自己的ciou_loss,再求平均值</span> <span class="hljs-comment">conf_loss = tf.reduce_mean(tf.reduce_sum(conf_loss, axis=[1, 2, 3, 4])) # 每个样本单独计算自己的conf_loss,再求平均值</span> <span class="hljs-comment">prob_loss = tf.reduce_mean(tf.reduce_sum(prob_loss, axis=[1, 2, 3, 4])) # 每个样本单独计算自己的prob_loss,再求平均值</span> |

至此,结合代码,有关YOLO V4损失函数的实战部分也就说完了!

4.小结

本文结合了四个IOU损失的理论定义,以及CIOU在YOLO V4中代码定义,详细地分析了DIOU损失和CIOU损失。在当前目标检测模型中,这样的损失函数的确能够提高模型的表现,所以我认为后面这种损失函数会大量替代MSE损失函数做bounding box regression,所以弄懂并理解它们是有必要的。

插个题外话,其实我个人有关论文+专利+导师任务+自学的事儿不少。有时候会很久才会有时间进行更新。但是写这种总结性文章,能够让我更加深刻地对阅读的论文和代码进行理解,如果本文或者之前其他文章中哪里有理解错误的地方,欢迎批评指正,我们共同学习!

来源|周威@知乎,https://zhuanlan.zhihu.com/p/159209199

本文已获作者授权,不得二次转载。

本文仅作学术分享,著作权归作者所有,如有侵权,请联系后台作删文处理。

https://m.toutiaocdn.com/i6849718438852739597/?app=news_article×tamp=1598876236&use_new_style=1&req_id=20200831201716010129037237230BDF78&group_id=6849718438852739597&tt_from=android_share&utm_medium=toutiao_android&utm_campaign=client_share

转载请注明:徐自远的乱七八糟小站 » 深度学习——YOLOv4损失函数全面解析